L’evoluzione dei modelli Vision-Language-Action (VLA) rappresenta una svolta epocale nella robotica. Per la prima volta, stiamo dotando le macchine della capacità di percepire il mondo attraverso la visione artificiale, comprendere istruzioni in linguaggio naturale e trasformarle in azioni fisiche appropriate. È una forma embrionale di intelligenza incarnata, che fonde tre competenze fondamentali—vedere, capire, agire—e prepara il terreno per una nuova generazione di robot autonomi, versatili e collaborativi.

Questa rivoluzione nasce dall’integrazione di avanzamenti precedenti in ambito multimodale. I primi esperimenti nella comprensione congiunta di immagini e linguaggio, portati avanti con modelli come CLIP e Flamingo, hanno posto le basi per una rappresentazione semantica astratta del mondo. Il passo successivo è stato quello di connettere questa rappresentazione al controllo motorio continuo, aprendo la strada a robot capaci di muoversi e operare con un’intelligenza guidata dal linguaggio.

Tra i modelli più avanzati troviamo RT-2, che è stato addestrato su milioni di esempi visivi e linguistici e successivamente raffinato su traiettorie robotiche reali. La sua capacità di generalizzare è straordinaria: riesce ad affrontare compiti mai visti durante l’addestramento, rispondendo correttamente a comandi come “sposta un oggetto fragile in un luogo sicuro” o “raccogli qualcosa che somiglia a un frutto rosso”. In scenari operativi, ha raggiunto un tasso di successo superiore al 60% su task complessi, dimostrando una comprensione semantica del mondo che va ben oltre la pura ripetizione.

Un ulteriore passo avanti è rappresentato da Helix, un sistema che controlla robot umanoidi a corpo intero, inclusi movimenti delle dita, delle mani, del busto e della testa. Helix è in grado di rispondere a comandi vocali e adattare le sue azioni al contesto in tempo reale, mostrando fluidità e coordinazione sorprendentemente simili a quelle umane. Questo tipo di controllo, continuo e multimodale, costituisce una frontiera importante per applicazioni industriali, domestiche e sanitarie.

Anche nel mondo open-source l’innovazione è rapida. OpenVLA, un modello addestrato su quasi un milione di episodi robotici, ha dimostrato di saper controllare molteplici robot con architetture differenti, adattandosi a nuovi ambienti e task con pochissime ore di adattamento. Questa capacità di generalizzazione rapida—nota come few-shot transfer—è fondamentale per implementazioni scalabili nel mondo reale.

Un esempio concreto e molto promettente di applicazione è Galbot, un robot mobile sviluppato per ambienti domestici e assistenziali. Galbot utilizza un modello VLA per navigare, riconoscere oggetti, comprendere richieste verbali complesse come “vai in cucina, prendi una tazza e portamela in salotto”, e svolgere il compito in modo autonomo e sicuro. È una dimostrazione tangibile di ciò che i VLA rendono possibile: robot che non solo eseguono comandi, ma capiscono davvero ciò che gli viene chiesto.

Le potenziali applicazioni di questa tecnologia sono enormi. Nel settore logistico, i robot possono interagire con operatori umani usando un linguaggio naturale e posizionare oggetti fragili o ingombranti senza bisogno di programmazione manuale. In ambito domestico, possono offrire assistenza agli anziani o supportare le attività quotidiane, adattandosi ai cambiamenti ambientali. Nella manifattura, possono imparare nuove operazioni semplicemente osservando un operatore, mentre nei contesti di emergenza possono operare in autonomia, interpretando comandi vocali e navigando in ambienti caotici. Anche nel campo dell’educazione e della compagnia, i VLA abilitano robot capaci di conversare, spiegare, motivare e adattarsi agli utenti.

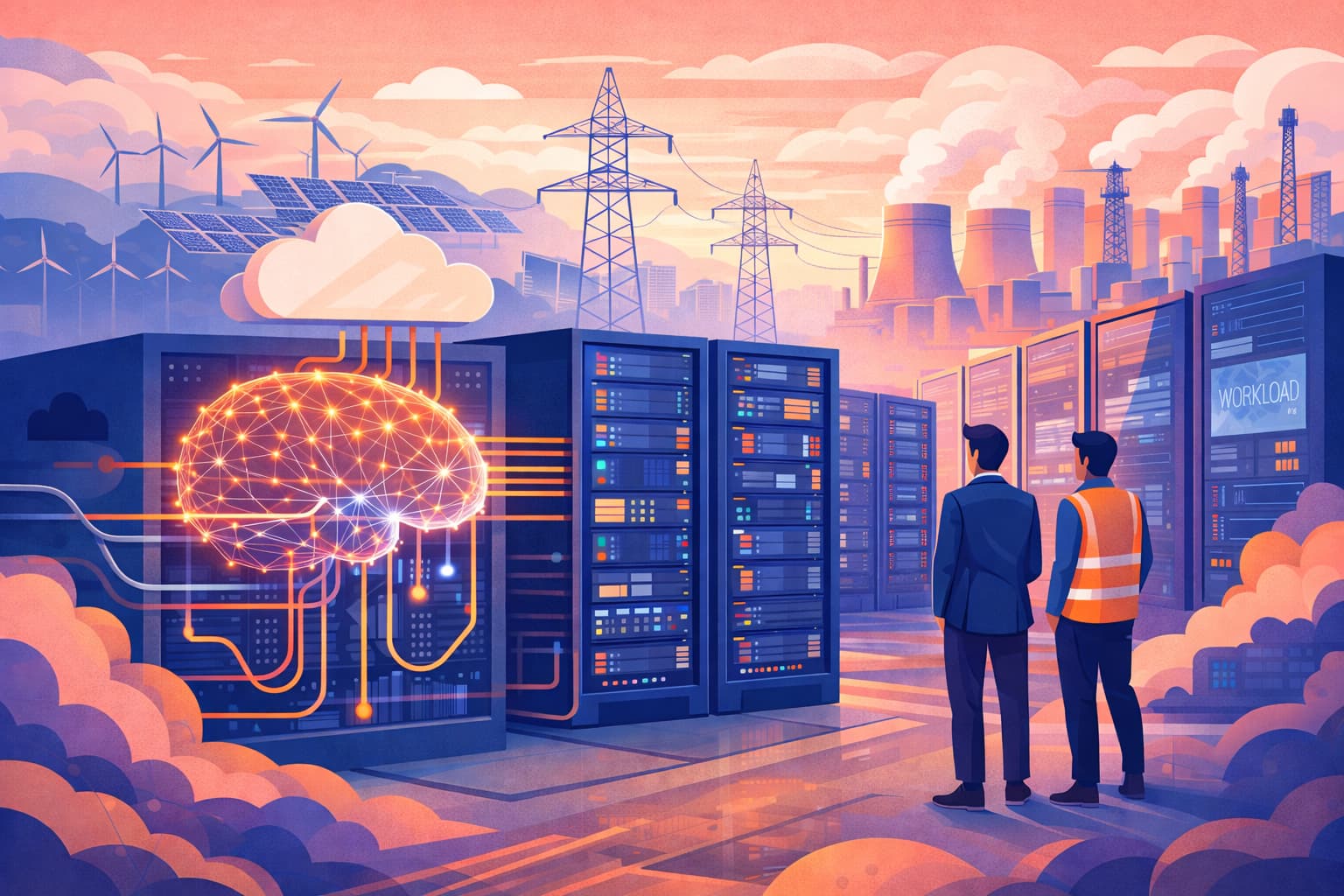

Questo potenziale ha già un riflesso concreto in termini economici. Secondo proiezioni recenti, il mercato globale della robotica intelligente — guidato in particolare dai modelli VLA — potrebbe superare i 300 miliardi di dollari entro il 2030. Una parte significativa di questa crescita sarà trainata da applicazioni nei settori della logistica avanzata, dell’assistenza sanitaria, dell’industria 4.0 e della robotica di consumo. I modelli VLA permettono infatti un aumento dell’efficienza operativa fino al 30-40%, grazie alla riduzione dei costi di programmazione e alla capacità di riconfigurare i robot per compiti diversi senza modifiche hardware. Le imprese che adotteranno questa tecnologia non solo vedranno un incremento nella produttività, ma potranno trasformare completamente i propri modelli di business, abilitando servizi personalizzati, automazione flessibile e interazione uomo-macchina basata sul linguaggio.

Tuttavia, è importante riconoscere anche i limiti attuali. I modelli VLA sono ancora sensibili a rumori visivi, ambiguità linguistiche e variazioni ambientali fuori distribuzione. La loro robustezza in scenari non controllati, la capacità di apprendere su lunghi orizzonti temporali e la sicurezza nelle interazioni fisiche con gli esseri umani sono sfide ancora aperte. Inoltre, l’energia computazionale necessaria per l’addestramento e l’esecuzione di questi modelli rimane significativa, ponendo interrogativi su sostenibilità ed efficienza.

Guardando al futuro, ci si attende che i VLA si evolvano verso architetture sempre più generaliste, capaci di integrare memoria, apprendimento continuo e ragionamento causale. Saranno in grado non solo di reagire agli stimoli, ma di pianificare, riflettere e apprendere da poche interazioni. La convergenza tra robotica embodied, intelligenza artificiale multimodale e linguaggio porterà alla nascita di agenti cognitivi in grado di muoversi e interagire nel mondo umano con fluidità, affidabilità e sensibilità contestuale.

Il salto non è solo tecnologico, ma concettuale. Non stiamo più semplicemente costruendo macchine. Stiamo creando sistemi che comprendono, interpretano e collaborano. È l’inizio di una nuova fase nella coesistenza tra umani e robot: non più strumenti, ma partner intelligenti.