La diffusione dell’intelligenza artificiale generativa sta trasformando Internet, minacciando l’equilibrio tra creatori di contenuti e motori di ricerca. Le risposte automatiche riducono il traffico verso i siti editoriali, compromettendo pluralismo, qualità informativa e sostenibilità economica. Il rischio è un progressivo impoverimento della conoscenza, con contenuti sempre più omogenei e meno verificabili. Per preservare un web aperto e credibile servono tre azioni: riconoscere economicamente le fonti, garantire trasparenza sull’origine dei dati e difendere il pluralismo online come bene pubblico.

Perché la generazione automatica delle risposte rischia di impoverire la conoscenza pubblica e cosa possiamo fare per evitarlo.

Internet è oggi la più estesa infrastruttura cognitiva a disposizione dell’umanità. Quasi ogni azione informativa parte da una ricerca online: configurare un dispositivo, risolvere un problema tecnico, valutare un prodotto o accedere a un servizio. Milioni di contenuti digitali — guide, spiegazioni tecniche, approfondimenti — sono stati sviluppati perché chiunque potesse orientarsi nella complessità del mondo digitale.

A rendere possibile questa economia diffusa della conoscenza è stato un patto implicito ma efficace: gli autori pubblicano contenuti liberamente accessibili; i motori di ricerca reindirizzano gli utenti verso le fonti; la sostenibilità dei siti è garantita dalla pubblicità e da modelli complementari. Un equilibrio che ha favorito pluralismo, trasparenza e alfabetizzazione digitale.

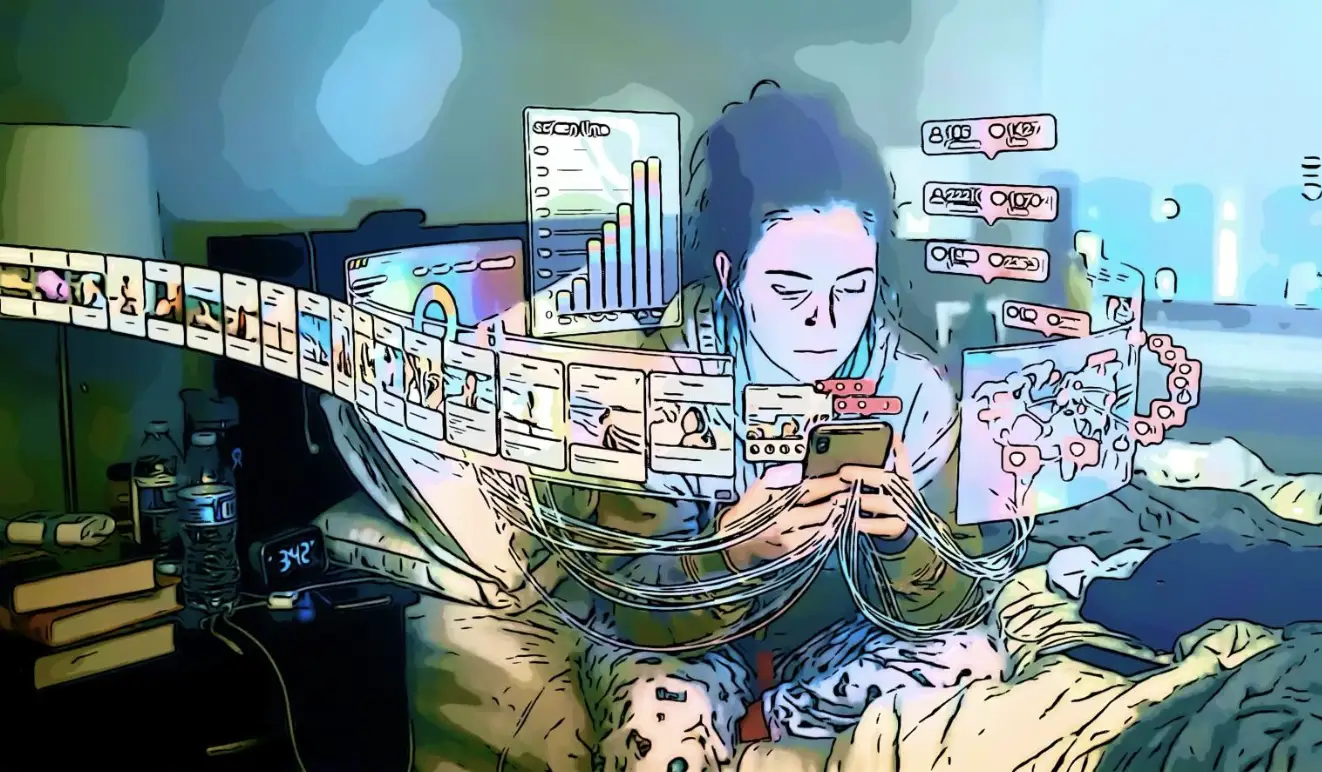

Con la diffusione dei modelli di intelligenza artificiale generativa, però, questo equilibrio sta cambiando rapidamente. Oggi la risposta non è più un percorso tra fonti e pagine: è una sintesi immediata, prodotta dal sistema di AI senza necessità di consultare il sito che ha generato il contenuto originale.

L’integrazione delle AI nei motori di ricerca sta riducendo in modo significativo il traffico verso i siti editoriali. Una parte crescente delle interrogazioni si esaurisce nella “risposta diretta” fornita dal modello, privando le fonti di visibilità e quindi di ricavi.

Per un settore che si fonda sulla pubblicità, la riduzione del traffico implica un’immediata contrazione della capacità di investimento nella produzione informativa. Dove i ricavi diminuiscono, si tagliano collaborazioni, si rallentano gli aggiornamenti, si rinuncia alla verifica dei contenuti. In prospettiva, alcuni attori più fragili potrebbero essere espulsi dal mercato.

Il paradosso è evidente: i modelli di AI si allenano proprio su quella conoscenza che rischiano di rendere insostenibile. Se la produzione si riduce, la qualità futura dell’intelligenza artificiale — che si basa sulla ricchezza del patrimonio informativo esistente — ne risulterà inevitabilmente compromessa.

La conoscenza, dunque, rischia di diventare una risorsa che si esaurisce più velocemente di quanto venga rigenerata.

La crisi che si profila non riguarda solo gli editori: riguarda l’integrità dell’informazione digitale nel suo complesso. Se la produzione originale rallenta, si verificano tre conseguenze convergenti.

In primo luogo, la qualità delle risposte potrebbe degradarsi. L’AI, privata di contenuti affidabili e aggiornati, sarà costretta ad attingere a un materiale sempre più povero, obsoleto, stereotipato.

In secondo luogo, cresce il rischio di distorsioni commerciali. Se la sostenibilità informativa dipende da chi controlla i canali di distribuzione, l’indipendenza del sapere diventa vulnerabile a chi può pagare per orientarne le risposte.

Infine, il pluralismo potrebbe essere compromesso. La chiusura di siti e la concentrazione dei contenuti nelle mani di pochi grandi operatori ridurrebbero la varietà dei punti di vista e la possibilità di verifica critica.

Un ecosistema informativo che non genera più nuova conoscenza tende verso una forma di entropia: tutto si uniforma, si ripete, si impoverisce. E la promessa della “risposta perfetta” rischia di trasformarsi in un circuito autoreferenziale privo di controllo umano.

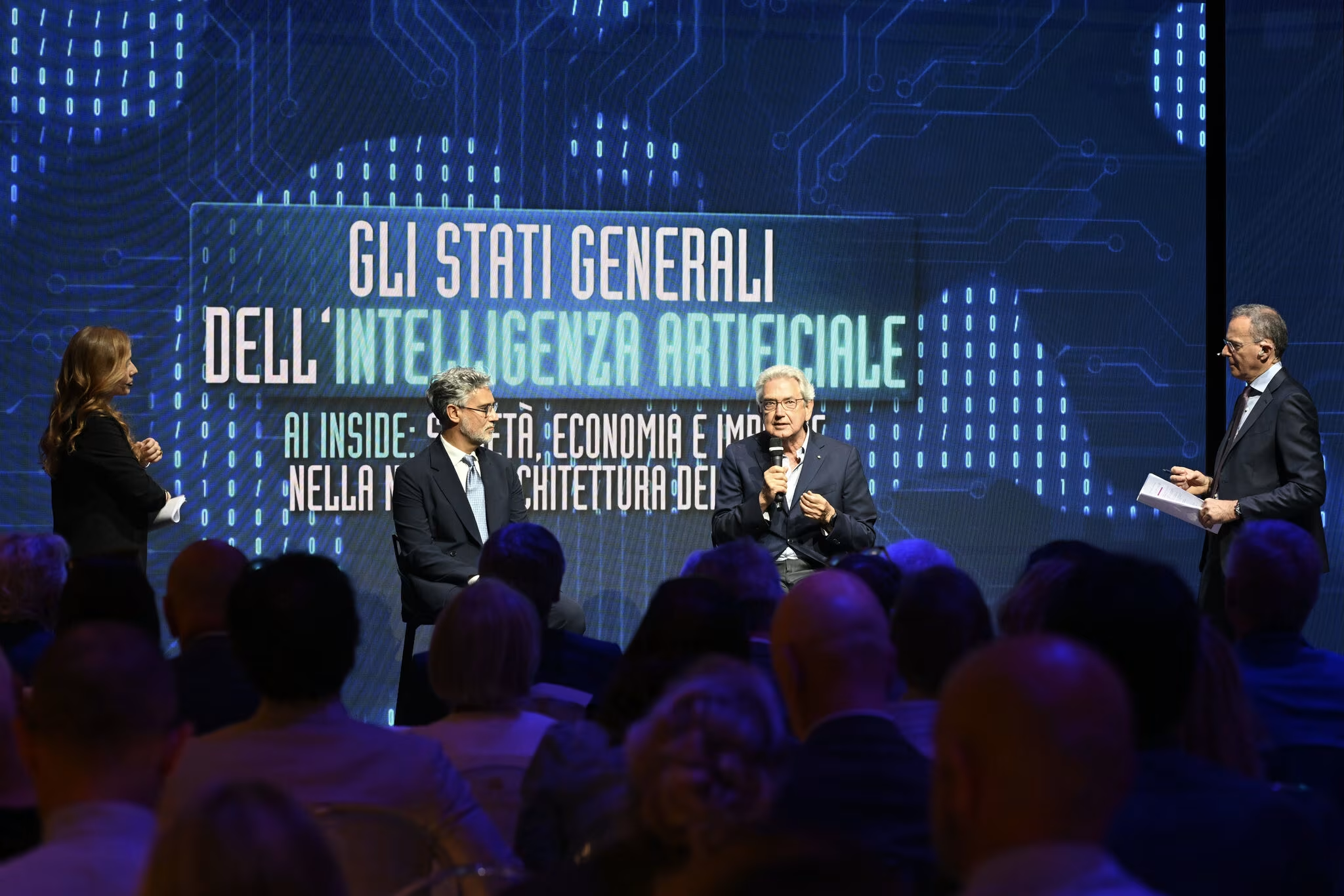

Siamo nel pieno di una fase costituente della società digitale. Non si tratta semplicemente di integrare una nuova tecnologia: si tratta di ripensare i principi che rendono possibile una conoscenza condivisa e verificabile.

Tre sono le direttrici che dovrebbero guidare un nuovo patto digitale:

1. Riconoscere economicamente la produzione della conoscenza

Attraverso modelli che remunerino l’uso automatizzato dei contenuti da parte delle piattaforme di AI.

2. Rafforzare la trasparenza nell’origine dell’informazione

Per consentire agli utenti di risalire alle fonti e valutare l’affidabilità delle risposte.

3. Tutelare il pluralismo online come bene pubblico

Garantendo che la conoscenza non sia ridotta a una funzione degli interessi di pochi soggetti dominanti.

L’intelligenza artificiale è un acceleratore straordinario della nostra capacità cognitiva. Ma continuerà a svolgere questa funzione solo se la conoscenza umana che la alimenta resterà un bene da produrre, valorizzare e condividere collettivamente.

Il web del futuro non può essere una vetrina di risposte senza autori. Ha bisogno di una comunità che continui a prendersi cura del sapere. Perché senza questa cura la tecnologia diventa più povera — e insieme ad essa, inevitabilmente, diventiamo più poveri anche noi.