La startup di intelligenza artificiale chiude una class action miliardaria con gli autori statunitensi, evitando un processo che poteva travolgere l’intero settore. L’accordo segna un precedente cruciale nel rapporto tra innovazione tecnologica, diritto d’autore e governance globale dell’AI.

Una transazione che chiude un caso dirompente

L’annuncio che Anthropic, una delle società emergenti nel campo dell’intelligenza artificiale generativa, ha trovato un accordo per chiudere la class action avviata da un gruppo di autori statunitensi segna un punto di svolta nella battaglia legale tra creativi e aziende tech. I dettagli economici dell’intesa non sono stati resi pubblici, ma l’impatto politico, giuridico e finanziario dell’operazione è già evidente: con questa mossa, l’azienda non solo si sottrae al rischio di risarcimenti potenzialmente miliardari, ma si ricolloca in un mercato sempre più sensibile al tema della proprietà intellettuale.

Il caso aveva assunto una dimensione esplosiva quando, nel giugno scorso, un giudice californiano aveva riconosciuto che Anthropic avrebbe potuto scaricare fino a 7 milioni di libri da siti pirata, configurando così una violazione massiva del diritto d’autore. Una prospettiva che, se confermata in giudizio, avrebbe aperto la strada a condanne capaci di destabilizzare non solo la start-up, ma l’intero ecosistema dell’AI.

Una questione di numeri: il rischio finanziario dietro la causa

Per Anthropic, valutata miliardi di dollari dai mercati privati e sostenuta da investitori globali come Amazon, Google e Salesforce, l’ipotesi di dover risarcire gli autori avrebbe potuto trasformarsi in un colpo sistemico. Oltre al danno economico immediato, la minaccia più grande risiedeva nell’effetto reputazionale: una startup percepita come “costruita sul furto” avrebbe avuto difficoltà ad attrarre capitali freschi e a mantenere rapporti con partner istituzionali.

La transazione, pur onerosa, rappresenta dunque una forma di gestione del rischio strategico: meglio pagare oggi per contenere l’incertezza domani, preservando l’accesso al credito e alla liquidità. In un contesto in cui i capitali di rischio stanno diventando più selettivi e in cui i mercati pubblici guardano con crescente attenzione alla compliance legale delle aziende tech, questo accordo appare come una manovra di sopravvivenza finanziaria oltre che legale.

Fair use o pirateria? La linea sottile del diritto dell’innovazione

Il cuore del caso non riguarda soltanto la violazione dei diritti d’autore, ma la definizione stessa di ciò che può essere considerato “uso lecito” nel training dei modelli di AI. Il giudice californiano aveva distinto due fattispecie: l’uso trasformativo di testi acquisiti legalmente – compatibile con il fair use – e il download massivo di opere da piattaforme pirata, che non può rientrare in tale cornice.

La decisione si colloca in una tradizione giuridica americana che tutela la libertà di innovazione, ma che al tempo stesso cerca di non erodere i diritti patrimoniali degli autori. Questo dualismo, però, evidenzia la mancanza di una cornice normativa chiara: mentre l’Europa con il regolamento AI Act ha adottato un approccio più prescrittivo, gli Stati Uniti si muovono ancora in un sistema casistico, nel quale le sentenze diventano precedenti e linee guida per l’intero settore.

Implicazioni per l’industria e per la politica industriale

La vicenda Anthropic non è solo un contenzioso giudiziario: è anche un laboratorio di politica industriale. L’AI è ormai considerata una tecnologia abilitante, capace di generare vantaggi competitivi nazionali e geopolitici. Se i dataset sono il “carburante” dell’intelligenza artificiale, chi li controlla determina chi potrà competere sul mercato globale.

Un accordo come quello appena siglato, se replicato, rischia di consolidare la posizione dominante delle grandi piattaforme, che possono permettersi di negoziare licenze e compensazioni. Per start-up più piccole, invece, l’accesso a dati di qualità potrebbe diventare proibitivo, accentuando il divario competitivo e riducendo la possibilità di un ecosistema realmente aperto. Qui si apre un tema di politica industriale: come garantire un accesso equo alle risorse di training senza compromettere i diritti d’autore?

La tecnologia sotto processo: dati puliti e responsabilità

La lezione per Anthropic e per l’intero comparto è chiara: l’era del “data scraping” indiscriminato è al tramonto. La costruzione di modelli sempre più potenti richiede dataset non solo ampi, ma soprattutto trasparenti e legittimi. L’industria dovrà orientarsi verso accordi di licensing, repository certificati e sistemi di tracciabilità.

In questo senso, il caso rappresenta un passaggio obbligato verso un futuro in cui la qualità dei dati sarà un fattore di competitività tanto quanto l’efficienza degli algoritmi. La sostenibilità tecnologica non è più solo ambientale, ma anche giuridica ed etica: la provenienza delle informazioni diventa parte integrante del valore industriale di un prodotto AI.

Geopolitica dell’intelligenza artificiale e governance globale

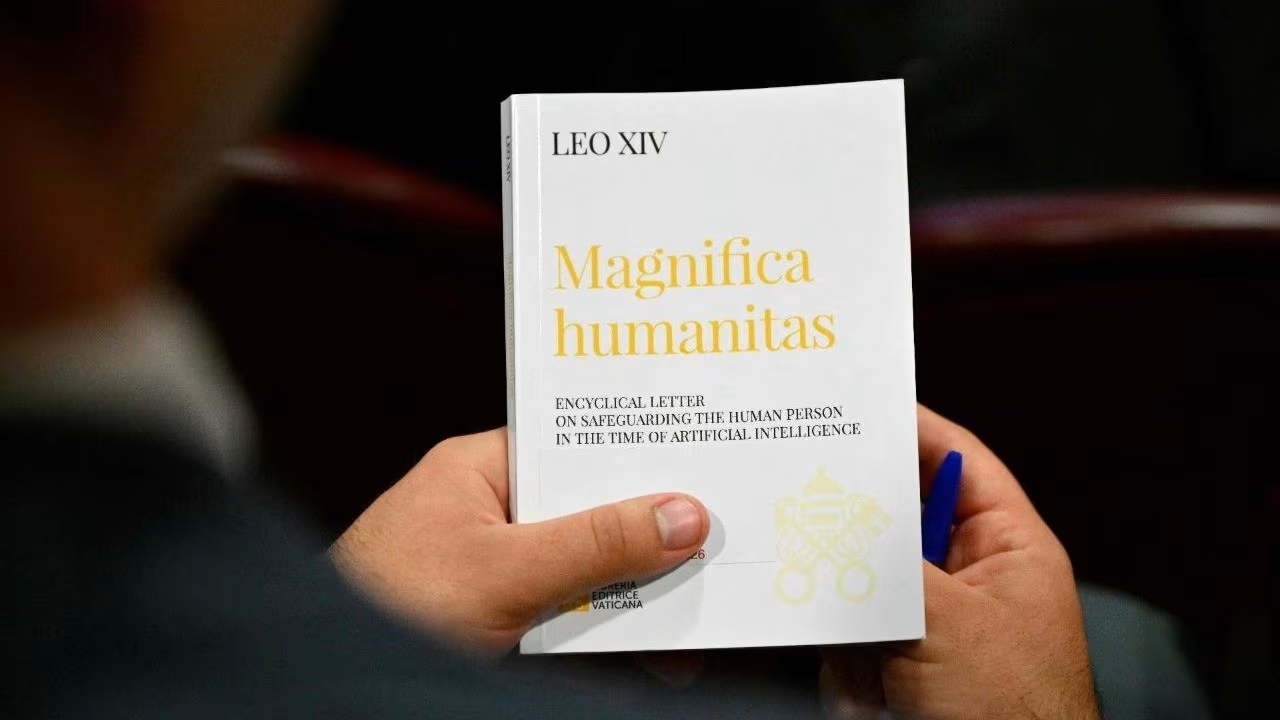

Sul piano geopolitico, il contenzioso ha trovato eco ben oltre le aule californiane. In un’audizione al Senato USA, lo scrittore David Baldacci ha denunciato la capacità dei modelli linguistici di riprodurre “l’immaginazione rubata” degli autori, portando il dibattito al cuore della politica americana. Parallelamente, senatori come Josh Hawley e Peter Welch hanno promosso il TRAIN Act, un disegno di legge che obbligherebbe le aziende a rivelare i materiali utilizzati per addestrare i loro modelli.

Questi sviluppi si inseriscono in un quadro di competizione globale per la leadership tecnologica. Mentre gli Stati Uniti cercano di bilanciare innovazione e tutela, l’Europa ha scelto un approccio più normativo e la Cina mantiene un controllo centralizzato sull’AI e sui dataset. L’esito di queste strategie determinerà non solo il futuro delle imprese, ma anche gli equilibri geopolitici di lungo termine.

Un compromesso che non risolve tutto

L’accordo di Anthropic con gli autori rappresenta una soluzione pragmatica a un problema immediato, ma non risolve le tensioni strutturali tra progresso tecnologico e diritti creativi. Se da un lato evita il rischio di una condanna che avrebbe potuto destabilizzare la società, dall’altro lascia aperte domande cruciali: come remunerare equamente gli autori i cui lavori vengono utilizzati per allenare i modelli? Come garantire che l’accesso ai dati non diventi un privilegio di pochi giganti?

Le prossime mosse saranno decisive. La regolamentazione, nazionale e internazionale, dovrà stabilire nuove regole del gioco, mentre l’industria dovrà dimostrare di poter crescere senza basarsi su pratiche borderline. In gioco non c’è solo il futuro di Anthropic, ma la definizione stessa del rapporto tra creatività umana e intelligenza artificiale.